例行晨读,读到这份白皮书。

作者是 Tom Chatfield 博士,一位英国的科技哲学家、作家与教育思想者,他长期关注批判性思维、AI 与未来技能等议题,并在包括出版、教学与国际演讲等多个场合探讨技术对人的影响。

这份题为《人工智能与教育学的未来》(AI and the Future of Pedagogy)的白皮书由全球学术出版机构 Sage 发布,并于 2025 年 11 月发布。

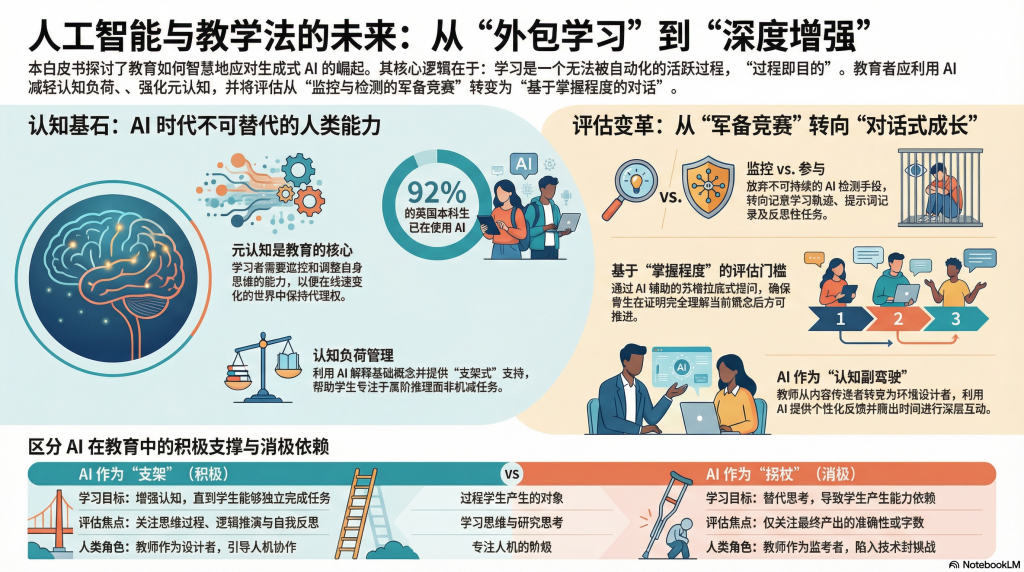

这份白皮书探讨了生成式人工智能对教育领域的深远影响,强调必须立足于人类学习的基本规律来推动技术创新。

作者指出,AI不应被视为简单的外包工具,而应作为提升认知能力的催化剂,防止其削弱批判性思维等核心技能。

文中提倡将教学评估从传统的监控模式转变为基于对话与掌握程度的新型体系,鼓励教师与学生共同探索技术的边界。

最后,该报告呼吁建立一个以伦理和人类协作为核心的教育未来,使技术真正服务于人类的智慧增长。

整个白皮书包括7个部分:

引言、四大核心部分、实践与建议、总结与展望;其中,

在引言部分,作者指出,生成式人工智能的快速发展正在深刻影响教育系统,但围绕 AI 的现有公共讨论往往陷入两种极端:

一是技术乐观主义,将 AI 视为一种几乎可以自动化学习与教学的“效率工具”;

二是技术焦虑,将 AI 视为对教育诚信、学习能力和教师角色的根本威胁。

报告认为,这两种反应都忽视了一个更根本的问题:

学习从来不是一个可以被外包或自动化的过程,而是一种深度的人类认知与社会实践活动。

因此,AI 对教育的真正挑战,在于它迫使我们重新回答“什么是有效的学习”以及“什么是值得保留的人类认知活动”。

报告强调,应从“是否使用 AI”的表层争论转向教学法核心问题,探讨学习的本质、知识构建、教师角色及教育目标。

其目标是建立一个概念性框架,使教育研究者、政策制定者和实践者能够理解 AI 对教学、学习和评价的深层影响。

引言明确,报告并非操作指南,而是为教育界提供分析工具和哲学思考的参考,以在 AI 时代保持教育的核心价值和人本导向。

第一部分:AI 对学习本质与知识观的挑战

报告指出,长期以来,学校教育隐含着一种以“个体认知加工”为中心的学习模型,强调理解、记忆、迁移与应用等内部心理过程。然而,生成式 AI 的出现使学习活动越来越多地呈现为一种人—机协同的分布式认知过程,知识不再完全存储于个体头脑之中,而是通过技术系统被即时调用与重组。

AI 能够生成文本、代码、图像与解释性内容,这在事实上模糊了“获取知识”、“加工知识”与“表达知识”之间的传统边界。

这种变化对以知识再现和个人产出为核心的课程目标与评价方式构成挑战。

报告并未简单否定 AI 对学习的价值,而是指出:关键问题在于,教育是否能够清晰地区分哪些认知活动可以合理地外包给技术,哪些则应被视为不可替代的学习核心。

在这一部分中,报告强调有必要重新界定“理解”“原创性”和“学习成就”等核心概念,否则 AI 的使用将不断冲击现有的教学正当性基础。

第二部分:AI 对教师角色与专业性的重塑

本部分讨论 AI 对教师角色的影响。教师的专业性包括课程设计、学习引导、评价判断与教育价值把控,而 AI 在内容生成与反馈提供上的能力可能取代部分传统任务。

报告强调,教师专业性不应仅被视为信息传递或标准化反馈,而应聚焦于学习情境判断、学生发展理解和教育价值把握。在此框架下,AI 应作为强化教师决策的工具,而非替代教师。教师教育与专业发展体系需要同步转型,以支持教师在 AI 环境下的主动角色,而非被动适应技术。

第三部分:AI、教学设计与学习活动形态的变化

本部分聚焦 AI 对教学设计和课堂实践的影响。

生成式 AI 支持开放、生成性学习活动,如问题探究、迭代写作和多模态表达,为突破线性课堂模式提供机会。然而,若缺乏明确设计原则,AI 使用可能导致学习目标模糊、认知要求降低或依赖增强。

报告强调,教师必须通过任务设计界定 AI 支持的环节与必须由学生独立完成的核心认知环节,从而确保 AI 被嵌入高质量教学设计,实现学习目标,而非降低认知门槛。

第四部分:公平性、伦理与制度层面的挑战

本部分分析 AI 引发的公平性、伦理和制度问题。学生在技术获取、使用能力及指导支持上的差异可能加大教育不平等,而 AI 算法偏见和输出不确定性也对评价、公平与信任构成挑战。

学术诚信问题被置于制度框架讨论,而非单纯视为“作弊”,报告警告,技术检测或禁止手段难以解决深层问题。

报告呼吁建立透明、教育价值导向的制度回应,在保护教育公平和开放性的同时,合理引导 AI 的应用,避免技术主导下的不均衡与潜在风险。

实践与建议部分:

实践与建议部分提出教师、学校与政策制定者的行动方向。

针对教育机构,白皮书提出了以下行动指南:

1. 明确 AI 的教育用途: 不要为了追求新奇而使用 AI,必须服务于明确的教学目标,如支持概念探索或自动化繁琐流程以释放教师精力。

2. 在作业中纳入反思性 AI 使用: 要求学生提交使用 AI 的日志(Log)和提示词记录,并解释其为何保留、修改或丢弃 AI 生成的建议。

3. 建立实验性“沙盒”空间: 允许教职员工和学生在不计入正式分数的情况下测试新的 AI 辅助评估模式,鼓励风险分担和共同进化。

4. 锚定公民与伦理使命: 始终审视:我们通过 AI 模拟了什么价值观?这些系统是否服务于公平、理解和人类发展的宏大目标?

总结与展望部分;

总结与展望强调,生成式 AI 是教育教学法的“催化剂”,而非中性工具。关键问题不是是否使用 AI,而是教育系统是否能在技术变革中坚持核心使命:促进深度理解、批判性思维与全面发展。

报告呼吁学术界开展更多教学法中心的实证与理论研究,以避免 AI 讨论被技术叙事主导。未来教育需在技术便利与认知挑战之间取得平衡,使 AI 成为人本教育目标实现的支持工具,并为教师专业发展、学习设计和制度保障提供理论依据。

这份白皮书的核心观点建立在两个基本原则之上:

第一,教育创新必须尊重人类学习的本质规律;

第二,人工智能的力量决不能削弱人类在 AI 时代生存所必需的关键技能。

报告强调,学习的过程本身即为目的,无法被自动化或外包。

教育者应当将 AI 视为深度学习的“环境”和“催化剂”,而非逃避思考的捷径。

报告建议将教学重点从“结果验证”转向“过程对话”,通过提升认知门槛和加强元认知能力,使技术服务于人类卓越能力的提升,而非取代。

综合来看,这份报告真正解决的,并不是“AI 怎么用”的问题,而是三个更底层的问题:

1、它澄清了教育中哪些东西不可被自动化

2、它为评估改革提供了强有力的价值论证

3、它为教师专业判断重新争取了合法性

这是一份“立场极其清醒”的白皮书,这是一份在当下 AI 教育话语中非常少见的“冷静报告”。

这份报告的最大优点在于:它几乎完全拒绝从“技术能力”出发,而是坚定地从“教学法与学习科学”出发。

在报告中,作者反复强调,AI 不会决定教育的未来,真正决定未来的是我们对“学习是什么”的理解。

报告最重要的贡献:把“AI 问题”还原为“教学法问题”。

因此,它并不是一份告诉你“该怎么做”的指南,而是一份不断提醒你“不能忘记什么”的报告。

在 AI 技术快速演进、教育实践充满焦虑的当下,

这种提醒本身就极其珍贵。

这种立场,使该报告在本质上更像一篇教育哲学—教学法宣言,而不是一份技术白皮书。

这一点,既是它的高度所在,也是它后续张力的来源。

本报告解读是借助AI完成的!部分文字也是AI生成的!全文经过本人审核!特此申明!

2026年1月23日 深圳 南方科技大学