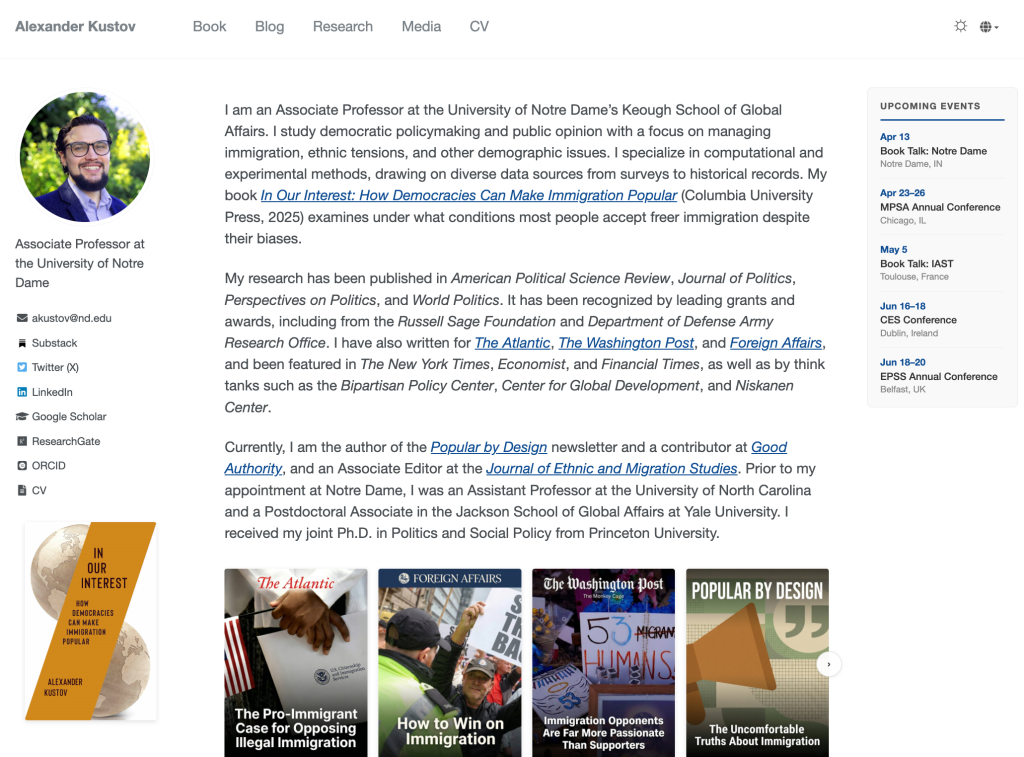

Alexander Kustov 是位政治学家。

亚历山大·库斯托夫是美国圣母大学基欧全球事务学院(Keough School of Global Affairs, University of Notre Dame)副教授,

俄罗斯裔美国人,他的研究方向是民主政策制定和公众舆论,尤其关注移民治理、族裔冲突与人口问题,擅长运用计算与实验方法进行跨数据源分析。

库斯托夫的代表作《为了我们的利益:民主如何才能使移民政策受欢迎》(In Our Interest: How Democracies Can Make Immigration Popular (Columbia UP),2025)探讨公众在何种条件下能够突破偏见、支持更开放的移民政策。

他的研究成果发表于多家顶级政治学期刊,并获得重要基金资助;

同时,库斯托夫也活跃于公共写作领域,为主流媒体与政策平台撰稿,是连接学术研究与公共讨论的重要学者之一。

为什么要讲到他?讲一位政治学家?因为他捅了学术界的马蜂窝。这是一起几乎注定会引爆学术界的事件。

2026年3月3日,亚历山大·库斯托夫在其Substack平台上发表了一篇题为《学术界需要对人工智能觉醒》(Academics Need to Wake Up on AI:Ten Theses for Folks Who Haven’e Noticed the Ground Shifting Under Their Feet)的文章。

在这篇文章中,Alexander Kustov为那些尚未意识到学术环境正在发生巨变的同事们提出了10个极具冲击力的论点:

1、AI 在社会科学研究方面的表现已经超过了大多数教授

AI 不仅能运行代码,还能撰写优秀的文献综述,并对现有观点进行富有成效的重新组合。通过有效的指令,AI 可以在几小时内产出达到顶尖期刊发表水平的论文。

2、学术论文是一种“行尸走肉”般的过时格式

科学的核心在于研究问题和分析过程,而长达 30 页的论文只是多余的“包装纸”。

传统的缓慢出版流程和付费 PDF 模式已经落后于时代。

3、商业期刊体系可能难以为继

随着论文生成成本降至约 100 美元,投稿量可能激增五倍,这将导致现有的同行评审和收入模式崩溃,期刊很可能被直接绕过。

4、学术界对 AI 持有荒谬的双重标准

虽然人们担心 AI 幻觉,但人类研究也经常存在引文错误、数据瑕疵和不可重复的问题。

如果用审视 AI 的标准来审视人类研究,一半的期刊今天就得倒闭。

5、青年学者面临最大的冲击与机遇

研究的瓶颈已从执行力转向了验证能力和原创思考。

拥有良好想法和 AI 工具的青年学者,其产出速度可以抵得上过去的一整个实验室。

6、研究助理(RA)的角色将从工作流中消失

作者不再雇人清理数据或起草综述,因为 AI 做得更快且成本极低。

未来的合作者需要提供的是原创见解、领域专业知识和智力挑战。

7、许多对 AI 的反对只是伪装成原则的身份保护

对 AI 的反感往往源于语言把关和地位维护。

学者的职责是推动知识边界,而非追求所谓的“手工打造”研究的自我实现。

8、真正值得关注的是安全与验证问题

不要纠结于 AI 是否“真正理解”知识,而应关注如何大规模验证 AI 生成的声明、防止 P-hacking(数据造假)以及保护敏感数据。

9、科学研究质量即将迎来飞跃

AI 正在使科学民主化,例如让非英语母语的学者能写出与名校水准相当的文章,并催生出全新的、交互式的研究设计。

10、除了末日预言,AI 带来的变革真正令人兴奋

AI 不仅有用,而且充满趣味。作者建议每位学者都应该花一个月时间关在房间里深度体验 Claude Code 等智能体系统,重新设计自己的工作流程。

这10个论断读完,你会不会觉得相当炸裂?!这些论断直接触碰了学术界的权威结构与自我认同,因此,迅速引发广泛关注与激烈争论。

随着文章传播,其影响力迅速扩大,获得了百万级阅读量和上千条评论。

在这些反馈中,不仅有严肃的学术反驳,也夹杂着强烈的情绪性回应,甚至有人公开呼吁对作者进行惩罚性处理。

这一阶段,争议仍停留在“观点是否正当”的层面,即围绕人工智能是否真正具备替代学者的能力,以及学术体系是否正在发生结构性衰变展开。

然而,事件的关键转折出现在第二篇文章中。

3月5日,亚历山大·库斯托夫在其Substack平台上发表了第二篇,《学术界需要对人工智能觉醒,第二部分》(Academics Need to Wake Up on AI,Part II),副标题是:对千条愤怒回应的反思(Reflections on a Thousand Angry Responses),

在这篇文章中,库斯托夫进一步揭示:

3月3日他所发表的那篇引发巨大争议的文章,实际上是由人工智能生成的。

这一披露将原本的观点之争,转化为一场关于“知识生产主体”的深层冲击。

也就是说,学术界激烈回应的一篇文章,其文本本身并非出自人类学者之手,而是机器生成的结果,这一事实本身构成了对学术评价体系与认知边界的直接挑战。

因此,这一事件的意义远不止于一次舆论风波,而更像是一种对当代学术体系的“压力测试”,一种刻意设计的系统性冲击测试,它同时挑战三种东西:

1、知识生产机制:谁有资格“生产知识”? 人工智能是否已经进入这一行列?

2、学术评价体系:论文是否已经沦为形式化、可替代的产物?

3、学术共同体的心理结构:对人工智能的抵制,是理性判断?还是学者的地位焦虑?

它迫使人们重新思考:

当人工智能能够在形式上生成高度“合格”的学术论述时,学术界所依赖的评价标准、权威结构以及知识生产机制是否仍然稳固?

更进一步地,这场争议所暴露的,或许不仅是对技术的分歧,

更是学术共同体在面对自身可能被重塑时所产生的深层不安。

在自留地君看来,学术机构和学者多面临的选择,比不过不是是否要拥抱人工智能,而是如何在这种已经发生变化的研究流程中重新定位学者自身的价值,优化产生公共知识的方法方法和效率。

您说,是不是这个理?

欢迎您跟帖分享您的主张!

Kustov, A. (n.d.). Academics need to wake up on AI. Popular by Design. Retrieved from http://popularbydesign.org/p/academics-need-to-wake-up-on-ai

Kustov, A. (2026, March 5). Academics need to wake up on AI, Part II: Reflections on a thousand angry responses. Popular by Design. https://www.popularbydesign.org/p/academics-need-to-wake-up-on-ai-part

Photo by Johnnie Walker