ChatGPT继续快速发展,并持续引发争议。

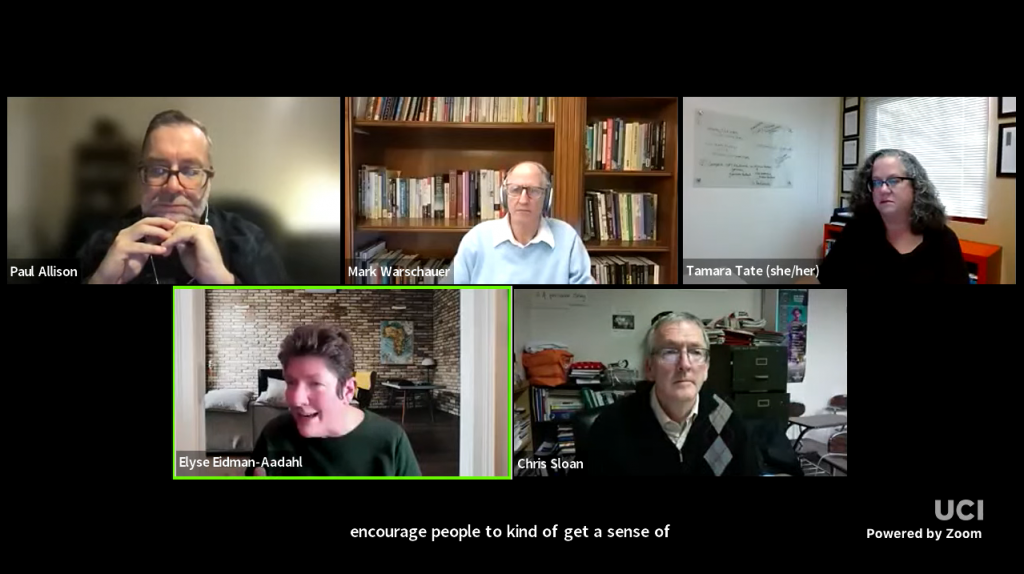

早上,参加了参加由 Write Center组织的《ChatGPT与写作教学的未来》(ChatGPT and the Future of Writing Instruction)网络研讨会,聆听了五位写作教学专家的讨论,很受启发。

五位资深英语写作教学专家分享了他们的创新、实践和思考,这个自留地君将另文分享学习心得,这里先按下不表。

在参加这个网络研讨会的过程中,自留地君就在想,我们在兴奋、忧虑,拥护或批评,鼓励或禁止 ChatGPT之类的人工智能的时候,我们不仅要首先学习和体验它,而且还需要知道它能干什么,不能干什么。如果没有这样的深度体验和思考,将它有用无用,有益有害,岂不是胡说八道,难以令人信服。

于是,自留地君就问 ChatGPT,请它回答两个问题:

一是, ChatGPT 不能做什么?

二是,ChatGPT 最常犯的10个错误是什么?

以下答案,均出自 ChatGPT,未经本人核实和勘误,仅供您参考:

ChatGPT 不能做什么?

GPT(生成式预训练转化器)聊天机器人是强大的工具,不幸的是它有一些限制。以下是GPT聊天机器人无法做到的前10件事。

1、回答他们专业知识以外的问题。

2、识别复杂的用户手势或理解微妙的细微差别。

3、给予个性化的回答,因为他们不能调整他们的答案,以考虑到个人的喜好或先前的对话。

4、进行超过几个回合的对话。

5、理解自然语言输入并产生准确和相关的反应。

6、处理图像或视频。

7、理解复杂的背景,如历史事件或随时间变化。

8、做出决定或判断。

9、识别并解决不正确的语法。

10、利用多种数据源。

ChatGPT 最常犯的10个错误

ChatGPT最常犯的10个错误如下:

1、不能正确理解上下文

ChatGPT有能力识别上下文,但是,有时不能在对话中识别正确的上下文。

2、提供不正确的答案

ChatGPT并不总是正确的,因为它是根据可能不准确的数据训练的。

3、产生无益的回应

ChatGPT可能会产生与对话无关的回答,或者可能没有回答问题。

4、生成过多的信息

ChatGPT可能会产生大量的信息,而这些信息可能对谈话没有帮助或与之无关。

5、产生不适当的内容

ChatGPT可能会产生冒犯性的、不敏感的或不适当的内容。

6、生成重复的内容

ChatGPT可能会生成在对话中已经提到过的内容。

7、不使用自然语言

ChatGPT可能会产生过于机器人化的语言,而不是对话式的。

8、不理解用户的意图

当用户提出问题时,ChatGPT可能不理解用户的意图。

9、不回应用户反馈

ChatGPT可能无法识别用户的反馈,也无法在产生反应时将其考虑在内。

10、不理解人类语言的细微差别

ChatGPT可能不理解人类语言的细微差别,因此可能产生过于含糊或不准确的回应。

By Johnnie Walker via AI